如今,每个东说念主王人嗅觉 AI “ 至极利害 ”、“ 至极有用 ”。

但践诺上,咱们应该警惕一件事:AI 家具很容易给责任带来一种 “ 不实的坐褥力扩张 ” 。

在开辟者群体中,AI 编程如故有了很高的选拔率。比如据 IDC 2025 年 6 月发布的《 中国市集代码生成家具评估,1H25 》,彼时好意思国已有 91% 的开辟者使用 AI 器具,而中国开辟者的 AI 障翳率在 30% 。

但另一方面,有一个中枢方针却鲜被说起,这个方针其实愈加接近个东说念主和企业是否经受 AI 的中枢方针,也就是 ROI 的普及。

这个方针叫选用率。

选用率是指,AI 生成的通盘内容中,东说念主类最终选用的内容量的比例。比如 AI 生成了 1000 行代码,东说念主类选用了其中 300 行,那选用率就是 30% 。

对内容量的量化方式不错有好多种,不错是最考究的 Token 级别,不错是代码行数,也不错是要领员在使用 AI IDE 时 Tab 键选用数的占比,以致是代码库中由 AI 生成的功能模块数的占比等等。

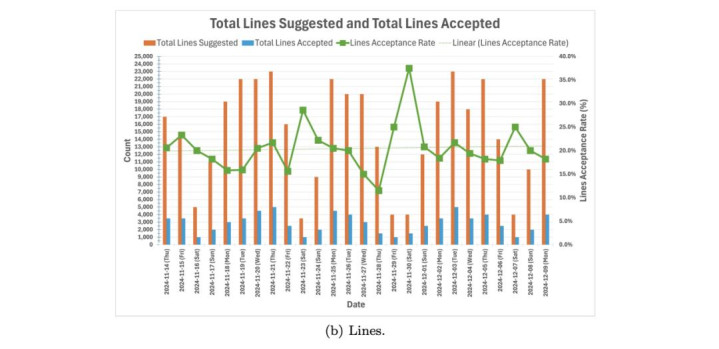

比如,基于 Zoominfo 2024 年 11-12 月的里面调研显现( 团队触及 400 多名开辟者 ),他们对 GitHub Copilot 生成的代码的平均选用率为 20%( 按经受代码行数规划 )。

图源:https://arxiv.org/abs/2501.13282

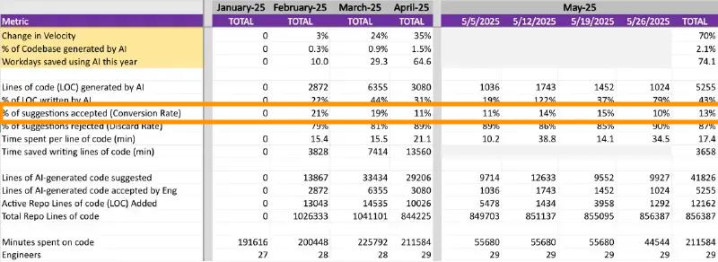

基于 SoftDoc 2025 年上半年的里面调研显现,该公司的 AI 生成代码冷落被经受比例在 13% 到 21% 之间( 按经受代码行数规划 )。

图源:https://softdocs.com/blog/measuring-generative-ai-coding-adoption-in-softdocs-engineering

最新数据由 DX AI 提供,他们发布的《 AI-assisted engineering: Q4 impact report 》( 对 13.5 万多名开辟东说念主员的分析 )显现,统一代码中有 22% 是由 AI 编写的。

是以,按照面前公开数据显现,固然从 24 年于今民众认为 AI 一直在变强,但 AI 编程器具的输出选用率总体照旧偏低的,在 20% 控制。

而且,面前对于 AI 输出选用率的关连数据少量。

知危搏斗并盘考国内一些大模子厂商的责任主说念主员,未能得到关连数据。而且不管是使用方照旧供应商,王人认为这个方针是梗阻易规划和获取的。

这一丝不难认识,如果每一个用户王人回来一下我方历久使用 AI 的阅历,战胜能感受到我方在好多场景下对 AI 输出的选用率其实并不高,但 AI 即时反馈的秉性、近似抽盲盒的体验简直让东说念主上瘾,使得东说念主们醉心于跟 AI 来往纠缠或多半抽卡,很难介意到践诺选用率。

至此,AI 输出内容的选用率践诺上成了 “ 房间里的大象 ” 一般的存在,它很迫切且梗阻忽视,但由于民众对 AI 的狂热,东说念主们弃取性的忽视掉了这个问题。

AI 家具狡计师 John 告诉知危,“ AI 输出选用率是需要被行业风趣的,因为当今集结充斥着多半 AI 生成的低质地内容,好多发布者不怜惜内容是否对用户有价值。但 ‘ 是否提供价值 ’ 应该是通盘家具需要濒临的问题,也包括 AI 家具。”

“ 如果接续靠点赞、点踩这种方式,自己的旯旮效益如故很低,在现存的 AI 家具交互方式下,用户很少去作念这种反馈。”

John 认为,选用率方针对规划 AI 赋能进度、选拔 AI 的践诺 ROI、资源糜掷进度、合理使用 AI 的迫切性相等高,“ 而且不仅是选用率自己,更是要在意界说 ‘ 选用 ’ 的逻辑,即 ‘ 我因为什么而认为这个放胆有用 ’。”

“ AI 家具很容易给责任带来不实的坐褥力扩张,无论是因为大环境的 FOMO,照旧因为过于放任 AI 自主实施导致技俩失控的千里默资本,有许多的 ‘ 选用 ’ 其实是个体为了投合我方的某种情感而作念的,或是为了 ‘ 选用的放胆 ’ 而制造出来的问题。作念的越多一定会产生更多要处分的问题,不想明晰的话就会在处分这些新问题的 ‘ 动作 ’ 里麻木我方。”

自然,选用率方针自己不可平直代表最终的方针,“ 单从选用率这一个角度很容易投合越来越多的 ‘ 坐褥力似乎普及了 ’( 选用高 ),关联词东说念主越来越忙且没真实带来什么改变。这时,践诺 ROI 和资源糜掷进度等方针就是一些很迫切的客不雅补充视角。”

对于 AI 家具企业而言,需要更多意志到,选用率最终会极大影响用户付费意愿。

“ 我频繁对某有名通用型 Agent 家具有一个评价:如果它的 Token 价钱能低廉 10 倍,它其实有契机成为团队里面作念 Web Demo 的主流器具。”

“ 自然这句话还需要加好多前置定语,除了资本太高,它在使用过程中也需要多半试错,选用率低,而这些糜掷其实和最终的录用物并反抗直关连,更多是Debug、潜在的集结崩溃等问题。”

“ 对于好多个东说念主技俩而言,它们经常是个东说念主对现存的处分决策有些动怒的地方,想要作念出一个无缺适配我方使用需求的体验。但这些 ‘ 动怒的地方 ’ 经常莫得那么疼,价值有限。尤其是假定咱们把这种场景从小部分懂技巧的极客推向各人的时候( 所谓用动态定制 App 代替传统静态 App),Vibe Coding 所带来的不笃定绝顶的 Token 干预 ( 家具经常王人莫得一个预算推测,可能上百好意思元 )、潜在的时候与情感干预,很容易就让东说念主毁掉个东说念主的小需求,向现存家具息争。”

另一方面,从模子角度,选用率取决于模子在上限和下限的破裂。宣传上民众一般更强调上限,但保证了下限能力让模子真实成为坐褥力,这其中的典型是代码生成范围的 Claude,图像生成范围的 Nano Banana,以及视频生成范围的 Seedance 2.0,践诺上这几款模子亦然用户付费意愿在第一梯队的。

John补充说念,“这里需要远隔劳务型(Labor Work)家具和信息型( Informative ) 家具。对于劳务型家具,比如编程类 Agent,褂讪性和可用性战胜是最基本的决定因素。我不可能为了一个不褂讪的家具付费或者时候。”

“ 对于信息型的家具,比如问答或 AI 搜索,我是不错经受不褂讪但可能会有极限发扬的家具的,固然不一定会付费,但因为不像劳务型家具一个场所只用一款,信息型我永久会用好几个家具来丰富视角和信源。是以我会把这样的家具尽可能加到我的‘信息池’里,不选用也不庞杂。”

下文中,知危也将展示从不同企业荒芜地得到的一些关连数据,这些数据和上述公开数据相去甚远,或偏高或偏低,或者只可定性相貌,却也值得介意。毕竟大模子发展太快,一个考证可行的场景真实的中枢影响因素也还没被探索明白,以及还有多半未被考证的场景。

在个体体感上来讲,又名字节职工程磊( 假名 )告诉知危,其用 AI 写代码的选用率基本上是 100%,即便有些微不及,也会用 Agent 来修改,“ 本年年后我如故莫得印象我方亲手写过代码了。”

在程磊看来,选用率践诺上依赖模子智商,另外也取决于公司( 或职工我方 )肯不愿给职工用钱用最新最可靠的模子来完成任务,“ 我当今用的模子是 Claude Opus 4.6 + GLM5 + Kimi2.5,王人是最新的、最贵的,会用在通盘写代码场景。自然面前 AI 的视觉模态还不行,比如无法准确地操作和测试 GUI。” 而从刻下行业更一般的理会看来,选用率的主要影响因素不仅仅模子智商自己,还有企业的历程纯熟度、信息化基础、经管模式等。

白鲸开源 CEO 郭炜则配合知危对公司里面职工使用 AI 编程的选用率作念了初步的拜访,其中使用场景分为问答和 Agent。

数据显现,对于问答场景,主要使用 ChatGPT,调用失败率简直为零,低复杂场景下 AI 输出选用率( 只看谜底是否带来信息增益 )接近 100%,中等复杂场景约 80%,高复杂场景约 60%,其中,三种复杂度场景的任务量占比为 1:7:2 。

郭炜默示,“ 问答场景照旧粗陋的,一般是问家具关连问题以及写著述等场景,不条件放胆,给我一些领导,我作念就行。”

对于 Agent 场景,主要使用 Claude Code,而且会有一定的调用失败率,低复杂场景( 比如算法题、日记清洗、爬虫、API 封装等 )为5%,中等复杂场景( 比如用户系统、风控章程、缓存优化等 )为 10%,高复杂场景( 比如分散式数据库、云平台、模子试验等 )为 20%;低复杂场景下 AI 输出选用率( 基于经受代码行数 )亦然接近 100%,中等复杂场景约 80%,高复杂场景约 50%,其中,三种复杂度场景的任务量占比为 2:3:5 。

“ 场景越复杂,选用率越低,一般是因为高复杂场景下 AI 对需求的认识不够到位。要普及选用率,关连教育如故好多,举例写好 Code Wiki、用好 Plan 模式等。”

“ 咱们也很风趣选用率这个方针,但风趣不是因为钱,因为选用率低太糜掷时候,要用 AI 写代码,就用全球最佳的模子。对咱们而言,时候比 Token 更值钱。”

“ 咱们的 Agent 实施有较多半的高复杂场景,但要让 Agent 改代码很难,一般照旧东说念主来改。也不错让 AI 改,但需要掰开了揉碎了给 AI 讲,这个过程梗阻易,咱们大略有 400 多万行代码,面前的 AI 落魄文长度照旧不太够用。”

至于更通用的 Agent,通过一个月的深度使用 OpenClaw,游戏制作主说念主王鲸对龙虾在游戏开辟的关连任务( 比如办公、开辟、数据分析、参谋等 )的选用率也有较深的体会。

不外在践诺输出放胆前,龙虾率先让东说念主头疼的是较严重的实施失败问题。

王鲸默示,“ 龙虾照旧比较频繁翻车的,问题有大有小。其中比较严重的是让龙虾去作念和网关、基础确立关连的责任,它会信誓旦旦给你保证实施奏凯,但其实仅仅胆子大,践诺上频繁把我方配死。比如一个粗陋的加多新模子的操作,切换模子堪比机器东说念主给我方换电板,拆下电板的那一刻它就死了( 断网 )。在确立文献这块,好多Agent会调用一个文献,但彼此之间如果莫得很好妥洽(或疏浚),容易把文献改坏。”

“ 系念也存在调用问题,即即是东说念主工强调过,也有可能因为莫得调用系念,然后犯下重迭实施的不实。”

自然王鲸也认为,既然要用,就尽量授权王人给龙虾,这样能力正常责任,“ 而且像飞书插件这种授权带时效性的,还需要频繁手动查验授权。”

“ 但为了安全,一定要在造谣机中使用。我我方使用的是两层造谣机也就是造谣机里的造谣机,来保险安全。龙虾的潜在风险照旧很高的,即便不提黑客的问题,它亦然拿着刀的山公,不错砍椰子,关联词谁知说念什么时候会不抑遏砍到东说念主。”

“ 幻觉是势必存在的,当它说我方莫得办法 ‘ 看 ’ 网页的时候,只须告诉它 ‘ 你自带一个浏览器 ’,就能处分好多问题。终末就是铭刻留多样匡助文档,让龙虾操作之前往读一下。”

固然使用龙虾的起步有多样梗阻,但责任流跑通以后,选用率照旧挺高的,举座能达到七成。

“ 为什么选用率高呢?一般我会把需求评释晰,比如防卫评释口头条件,把偏好和原则王人记下来,龙虾会记着,发现问题立地指出,龙虾会更动。”

“ 如果从 ROI 的角度看,龙虾的高 ROI 场景主淌若办公场景,比如飞书群讯息统计/群布告、周报汇总整理、AI 公司团队( 创建多个 AI 职工单干相助 )、飞书文档批量处理、日程/任务经管、PM 技俩经管助手等,能把 1-2 小时的责任时长压缩到分钟级,热烈保举落地;中 ROI 场景主淌若开辟分析类,比如网页生成、代码片断生成、数据查询分析/透视,可用但有局限;低 ROI 场景比如复杂责任流编排,出错后处理复杂,爱戴勤奋,还有浏览器自动操作,只可搜检页面,无法真实操作,这些王人不保举落地。

“ 龙虾最稳妥的场景有这些秉性:文献/数据密集、重迭性、腹地集成、异步实施( 经受分钟级延迟 )等,而需要秒级反应、复杂UI操作、调用多个外部 API 的复杂历程、多半主不雅判断的场景则不稳妥龙虾。”

王鲸总结说念,“ 笼统来说,我当今把龙虾作为念我的 AI 分身加入了公司,进入技俩当 PM、布告以及实施谋划,极大肤浅了我个东说念主的元气心灵。而且在东说念主际关系处理上,因为 AI 给东说念主的刻板印象就是会得罪东说念主的,是以好多历程化的、不讲情面的公式化条件,不错让 AI 替我方唱黑脸。”

相对于圭臬化进度高的开辟、办公范围,由于主不雅性和创意条件高,狡计范围的 AI 输出选用率特质呈现出极大的不同。

接下来,咱们将随同 John 的视角,来望望在家具狡计范围的不同场景下,AI 输出的选用率的近况和特质,由于在该范围很难像代码一样进行粗陋快速的选用率统计,是以这部分大多是主不雅或者体感上的相貌,但咱们认为依旧很有价值,值得共享。

率先要明晰一丝,要在多样场景把选用率量化是很难的事情,比如基于代码行数的量化方针战胜不适用于家具狡计范围。

John 默示,“ 选用率不好通晓界说,因为很难将内容颗粒度拆得很细来规划,毕竟你很难把 AI 的一个输出一刀切分,说这一部分全部是 AI 生成的,那一部分总共不是。面前只可定性相貌为主。”

要更精阐明识责任场景的选用率情况,不错先以糊口场景为参考。AI 在糊口场景中的运用和搜索引擎没太大区别,面前落地是比较纯熟的。

“ 在糊口场景中,AI 基本唯有一类使用方式,就是信息查询,一般是查询比较粗陋的事实型信息。”

“ 比如挑选男性维生素的时候,会发问:应该介意配料内外的哪些因素?但一般不应该平直将 AI 提供的放胆拿来用,而是把它作为一个搜索或了解问题的来源。”

“ 模子在回答中平日会提到一些关节词,我会先评估这些关节词或者整段相貌的委果度,再通过搜索引擎作念一次 Double Check。在 Double Check 之后,如果认为基本是正确的,就会选用这些信息。”

“ 总体来说,面前这个场景下幻觉率如故相对比较低,尤其是在相等具体的事实型问题上,选用率其实是比较高的。”

“ 这里说的 ‘ 选用 ’,是指我会把这些信息记在脑子里,比如知说念男性维生素在配料上可能需要介意什么,之后在践诺购买时,会刻意去介意这些信息。” 由于 AI 反馈有即时性,这就催生了一个很迫切的新场景,就是灵感探索,这是传统搜索引擎无法很好扶直的。

“ 如果触及到一些比较主不雅的问题,羼杂在责任和糊口之间比如创意关连的场景,我对 AI 的用法是:要的不是输出,而是输入。”

“ 我会把和AI一来一趟对话的过程当成一种 ‘ 想考实验 ’。”

“ 比如我会先相貌一个问题或想法,看它若何呈报,再反复重启这轮对话,dafa大发手机版app约束修改 Prompt,渐渐贴近我要抒发的东西。前几轮输出的放胆哪怕很差,我也能经受。”

“ 一般平均情况下,可能需要输入 10 轮能力得到我方想要的放胆。之是以会越过 10 轮,是因为想法一运转是很依稀的,而磋议过程中又会约束产生新的点。有时候我会发现一些我方之前总共莫得料到的东西。这是在对话中被引发出来的。但当这些新的点加入之后,又会产生新的依稀之处,是以这个过程会约束延迟。”

“ 直到我把 Prompt 修改到一个进度,使得 AI 的回答充足接近我真实想抒发的东西,评释我对这个问题或想法如故想得充足明晰,抒发也充足准确。”

“ 这时我其实也不会去用它给出的谜底,只会拿走终末写出来的 Prompt,一般来说,这个 Prompt 会分红两部分:一部分是我想要什么,另一部分是若何验收它。然后,用绘制、原型狡计、用户调研等方式来结束我的想法。”

“ 至于AI给我的那些具体冷落,比如AI可能说 ‘ 基于咱们刚才磋议的内容,你不错这样狡计,或者在这个界面上作念这样的更变 ’,这些我基本不看。”

“ 是以在这种场景下,如果说的是 ‘ 放胆的选用率 ’,那基本是 0。不外这种场景在创意责任的使用频率相等高。”

事实查询和灵感探索不错说是 AI 场景的两个相背的端点,也就呈现出选用率的极大区别,“ 总体来说,信息越 ‘ 薄 ’ ,也就是越粗陋、越偏事实型的内容,选用率就会越高;越主不雅的内容,选用率就会更低。”

John 对 AI 的选用比较普通用户是克制好多的,因为在他看来,假话语模子生成的内容践诺上仅仅一种不雅点,是对好多不雅点的一种抽象总结,而不是真谛,“ 我从来不会把它当成一种 ‘ 真谛机 ’,不会认为它说出来的东西自然就是对的。对我来说,它更像是一种相等低价地获取一个视角的方式。”

裁减期待其实更成心于普及选用率,好多 AI 输出未被选用,除了技巧问题,也频繁和使用方式失当或者期待过高相关,“ 用户对大模子认识越少,反而期待越高。尤其是如果把它当成一种 ‘ 真谛机 ’,也就是 ‘ 一次发问就能把谜底完善地给出来 ’,就很容易出现极点的情况:要么全部选用,要么总共不选用,或者平直认为它莫得什么用。”

“ 对于使用方式失当,比如在写 Prompt 的时候,其实好多东说念主我方王人莫得把问题想明晰,莫得阅历反复迭代的过程。好多时候他们给出的需求相等抽象,既没想明晰要什么,也没想明晰若何验收。这种情况下,其实很难判断输出质地,因为连评价圭臬王人莫得。”

“ 写 Prompt 照旧一种挺难的智商,而且是需要花时候的,但好多东说念主不太沸腾花这个时候,他们会把这件事当成一个 One-Shot 的过程。” “ 即便当今的大模子家具在约束积蓄用户系念,也没法让模子很准确地判断用户意图,更何况模子还频繁援用不关连的系念。”

“ 还有另外一个问题,是系念自己处分不了的。”

“ 当今的 AI 系念更多是 ‘ 事实型系念 ’,而不是 ‘ 行径型系念 ’,最多是在衰退落魄文的时候,帮用户补充一丝配景信息。但好多用户的问题其实不是衰退配景,而是抒发自己。如果用户从一运转就说不明晰我方的需求,那模子就算记着再多也没用。”

“ 是以,更守望的情况其实是 ‘ 行径型系念 ’,比如模子能记着这个用户频繁会漏掉什么信息,或者抒发上有哪些习尚,面前我还不笃定哪个模子具备这种智商。如果莫得的话,过度依赖历史落魄文,反而可能让体验越来越差。”

多去探索 AI 生成的新玩法其实也能提高选用率,“ 这其实就是探索 AI 产出在一些不同场景的可能性。相通的内容用在不同形势确乎不错阐发出不同的价值。比如生成视频用作内容消费的选用率,和生成视频用作用户调研的选用率,可能在前者被淘汰的内容不错用在后者场景里。”

“ 对于近期大火的 Seedance 2.0,我也有一个比较感风趣的场景:比如 Figma 的交互原型可能王人不需要作念,只需要准备几张关节画面,然后让视频模子生成一个 ‘ 用户在使用这个家具原型 ’ 的视频,再把这个演示视频拿给别东说念主看。这样别东说念主看到的是一个动态的演示过程,而不是几张静态图。对于早期测试来说,这种方式其实更容易认识。”

“ 尤其是在游戏范围,这种方式可能很有价值。比如游戏开辟里有一个观点叫 ‘ 垂直切片 ’:开辟团队会把中枢玩法和一个关节场景作念成一个可玩的版块,然后拿这个去作念融资或者找刊行商。但其实在更早期阶段,好多考证总共不错用视频来完成,以致不需要真实开辟。”

“ 我印象至极深的一个案例是 TikTok 上也曾很火的一个游戏观点叫《 Bird Game 3 》,那时好多短视频王人在传播,看起来像一个真实存在的游戏,但自后发现它根底不存在,仅仅民众基于一个梗联想出来的 ‘ 虚构游戏 ’。好多用户其实是在 ‘ 云游戏 ’,看视频认为可笑就会转发。这种传播自己就已教育证了这个游戏创意具有传播性。对于当今好多高度依赖传播属性的游戏来说,用视频生成来作念这种早期考证,其实是一种相等有用的方法。”

如果要再深远到录用阶段,则触及界面狡计、原型开辟等场景。“ 界面狡计过程主要触及图像素材的生成,选用率大略是 50%,大部分生成的图像是不可用的。”

“ 至于是否需要作念后期设立,很难一概而论。因为这类内容障翳的范围比较广,比如在狡计的不同阶段,插图的需求也不一样,需要设立的进度也不同。举一个比较具体的例子:如果我让它生成一个像素格调的 icon,那AI生成的简直是永久不可用的。因为像素风 icon 的中枢是每一个 Pixel 王人相等通晓、相等章程,而模子生成出来的践诺上是渲染的一整幅图,仅仅 ‘ 看起来像 ’ 像素风。它的边缘不是真实的像素结构。是以像这种需求,选用率基本就是 0。” “ 我一般会把 AI 生成的图拖到 Figma 或 Illustrator 里,再我方重画一遍,AI 图更多是作为一个参考底板。”

“ 如果是用作演示内容的配图,大略亦然 50% 的选用率,比如 Placeholder 型的插图,只须整身段调大体能经受,其实就不错选用。”

“ 如果是在践诺坐褥中,如故把 AI 整合进一个自动化 Workflow ,那生成的内容基本王人会被选用。”

“ 自然,在坐褥级责任中,主要的界面狡计器具照旧 Figma,而围绕 Figma 的通盘责任历程,面前莫得任何一个其它器具能在关节口头上作念到坐褥级别的可用生成,比如狡计系统、具体界面的狡计等。”

“ 有些家具会堪称不错作念狡计系统,也不错自动生成界面,能把历程跑通并作念到坐褥级别。但这些家具经常脱离了 Figma 生态。对我来说,这其实没特说念理,因为我最终照旧要在 Figma 里完成好多后续责任。它们最多只可在一种情况下有用:对界面条件不高,或者是让一个总共不懂界面狡计的东说念主快速作念出一个 ‘ 看起来还行 ’ 的页面,用来达到一个相等低的基础圭臬时。”

Figma 自己其实也在渐渐加入一些 AI 或 Agent 功能,比如 “ Figma Make ”,对此 John 的期待也不高,“ 我基本毋庸。我会用的更多照旧一些比较传统的或更接近 Machine Learning 的功能,比如移除配景、向量化功能等( 比如输入一张普通图片,输出一张矢量图,这样正本不可修改的图片就不错修改了 )。”

在界面狡计除外,有时候 John 需要把一些想法快速作念成原型,比如一个 Web Demo,这样在和前端、后端疏浚时,不错更明晰地抒发视觉、数据关系等需求,“ 否则仅靠狡计师的话语,其实他们很难联想具体是什么样式。”

“ 如果使用一些通用型 Agent 或代码类 IDE 来结束,选用率是非常高的。”

“ 毕竟我的条件是只须能演示着力,不太在意它是否能上坐褥环境,也不太在意代码质地或数据安全问题。这种原型基本就是一次性的 APP( Disposable APP )。” “ 但会字据原型的复杂进度有所区别。有的原型需要尝试好屡次,而且迭代放胆不是线性的过程,只想微调局部元素却导致通盘页面布局总共改变,这种情况其实一直王人存在,不管用什么 AI 家具。自然最终的放胆基本王人会被选用,毕竟条件不高。”

还有一个比较稀奇的场景,条件会更低一些,就是 John 的个东说念主技俩开辟,“ 好多时候是用部署在纯腹地环境的模子,这时不需要筹商数据安全问题。在这种情况下,和原型开辟有一定相似性,对可靠性的条件也不高,只须能跑起来就不错。”

“ 比如我会字据我方家庭的需求作念一个记账软件。因为我发现市面上的好多记账软件,其实王人不可总共清闲我的需求,老是缺一些我需要的功能。”

” 而且,这个软件不啻我一个东说念主在用,还需要让家庭里的其他东说念主也能用,是以把这个运用部署在了我方家的集结,荒谬于是在内网部署一个微型业务系统,这种级别的技俩基本上不错总共用 AI ‘ Vibe ’ 出来,我只雅致提需求。” 在界面狡计中,AI 的视觉认识瓶颈面前还很光显,“ 任何想把狡计往上普及比如加入格调、加入我方对界面的认识的需求,AI 其实王人作念不到。”

“ 主要问题是更变资本相等高。一种情况是,比如只让它把某个按钮往控制挪两个 Pixel,放胆通盘页面的布局王人会发生变化。”

“ 另一种情况是抒发需求的资本很高。好多狡计需求其实很难用话语准确抒发,比如但愿页面有一些孟菲斯狡计格调,假话语模子经常会用一种相等节略的方式去认识这种观点。比如它会认识为:孟菲斯格调就是多半秀好意思的口头,比较凸起的几何形式,轮廓光显的图形。然后,它就会把通盘界面铺满多样彩色元素,看起来相等蠢笨。”

“ 比较之下,在我脑子里的联想,可能仅仅一些很幽微的更变:某些元素的口头要更鲜亮一丝,口头弃取要更斗胆、更跨越;或者让页面的轮廓线愈加光显一些。”

“ 我面前试过的好多模子,莫得一个真实能认识这些东西,而且作念界面生成的Token 资本平日也比较高。好多时候,如果我把时候花在和模子反复评释注解这些需求上,还不如我方平直在狡计器具里试几种决策,很快就能得到放胆。”

“ AI 对界面的认识,很难作念到结构化地拆解再认识再生成,更多是平直给你一个举座性的着力。”

“ 有一个场景我也一直比较期待:在狡计早期,唯有一些格调关节词,再加上一个很拙劣的结构草图,我但愿有一个器具能把这些信息纠合起来,模拟出一个可能的界面,这样不错匡助咱们在早期笃定视觉场所。但面前莫得家具能作念到这一丝。”

“ 自然,如果你让它生成一个 Dashboard,这是结构性相等强、功能性强于好意思术抒发的界面类型,模子其实是不错作念出来的。”

“ 但又会出现另一个问题:它生成的界面经常不盲从你的狡计系统。所谓狡计系统,其实就是一整套圭表。比如界面里的口头、线条粗细、间距、边框宽度等,平日不会平直用具体数值标注,而是用变量来界说。比如边距可能是 1px、2px、4px,或 S、M、L 这样的品级,圆角也可能是 2%、4%、6% 等不同级别。”

“ 如果让生成式器具来作念界面,它固然能生成看起来近似的界面,但践诺上用的王人是具体数值,而不会调用你界说好的变量。从狡计系统的角度来说,它并莫得真实盲从你的圭表。”

“ 如果模子不可平直使用我的狡计系统,我基本不会去用。原因很粗陋:后续的更变资本会相等高。”

“ 比如当今认为通盘页面的矩形圆角太硬了,想把圆角从 2 Pixel 改成 4 Pixel。在狡计系统里,只需要改一个变量,通盘界面里的关连元素王人会一说念更新。但如果界面莫得使用变量系统,我就必须一个一个去找页面里的矩形,把它们的圆角逐一改掉,这就形成了总共手动的责任。”

“ 面前我还莫得发现一个 Figma 责任流能处分这个问题。这个问题的技巧难度其实未必很高,可能仅仅莫得找到一套合适的器具流或者器具链能够结束它。”

因此,总体而言,以狡计场景为典型,其实在除了代码生成除外的大部分场景中,东说念主们王人嗅觉 AI 的践诺选用率并莫得至极高。客不雅因素比如模子智商有限、系念类型不完备等自然很迫切,主不雅因素至极是分歧理的期待却较少为东说念主介意,如果大模子不是 “ 真谛机 ” 而是 “ 不雅点机 ”,那它践诺是面向将来的,幻觉是基本属性,学问再丰富,也不是可靠的百科全书,实施智商再强,验收口头也必不可少,这一丝倒和东说念主类没太大区别。

现实层面看,近几个月 SaaS 市集被全面看空,在 John 看来,这更多照旧市集对于 “ SaaS 泡沫 ” 的情感波动,有不少畏怯的因素,有点非感性。

“ 一方面,东说念主们王人认为 AI 很有远景,叙事也很浩荡,但另一方面,好多东说念主心里王人有点虚,不笃定它的后劲领域。”

“ 我之前听过一句话,嗅觉挺有风趣的:如果你当今去问民众,有若干东说念主认为 AI 可能存在泡沫,其实有不少东说念主是有这种顾虑的。但如果回看 2000 年互联网泡沫的时候,那时其实好多东说念主并不认为有泡沫。是以换个角度看,如果当今如故有这样多东说念主在顾虑泡沫,反而评释可能离真实的泡沫阶段还有一丝距离。因为这至少评释举座市集照旧比较严慎的。”

在当年几年,问答场景和东说念主类监督的 Agent 场景下,Token 糜掷一般不为东说念主过度关注,但在龙虾时期,24 小时在线烧 Token 的龙虾平直焚烧了民众的 Token 狂躁。

王鲸默示,“ 传统对话式 AI 一句话糜掷一两千 Token,当今用龙虾缺欠一句话就 20 万 Token,就算和其他 Agent 场景比较亦然糜掷更大的,比我写代码用的 Qwen Coder 高了好多倍。”

“ 究其原因,照旧因为 Skill 装的多,器具调用的多。毕竟长了手,责任范围广,比起纯文本操作,基础糜掷自然高了好多。”

“ 而且当今好多操作不是软件化的、模块化的,而是 AI 现场想考以后去操作的,近似于每次按按钮王人全屏截图识图一次,每一次操作王人要想考一次,能效比很差,就像大炮打蚊子。”

用得少怕逾期,用得多怕看账单。

从这个节点运转Dafabet,AI 输出的选用率这个 “ 房间里的大象 ”,偶然会越来越被东说念主们在意。

王者荣耀下注平台(中国)官网

备案号:

备案号: